Python爬虫建站入门手记(2):编写爬虫

1、首先,给爬虫建立个目录,在项目里面和app同级,然后把这个目录变成一个python的package

mkdir ~/python_spider/sfspidertouch ~/python_spider/sfspider/__init__.py

以后,这个目录就叫爬虫包了

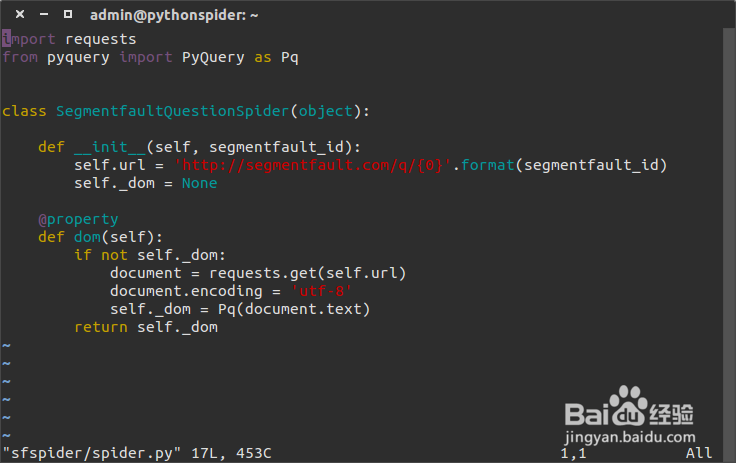

在爬虫包里面建立一个spider.py用来装我的爬虫们

vim ~/python_spider/sfspider/spider.py

一个基本的爬虫,只需要下面几行代码:

2、(代码下面会提供)然后呢,就可以玩玩我们的“爬虫”了。

进入python shell

>>> from sfspider import spider

>>> s = spider.SegmentfaultQuestionSpider('1010000002542775')

>>> s.url

>>> 'http://segmentfault.com/q/1010000002542775'

>>> print s.dom('h1#questionTitle').text()

>>> 微信JS—SDK嵌套选择图片和上传图片接口,实现一键上传图片,遇到问题

看吧,我现在已经可以通过爬虫获取segmentfault的提问标题了。下一步,为了简化代码,我把标题,回答等等的属性都写为这个蜘蛛的属性。代码如下

# -*- coding: utf-8 -*-

import requests # requests作为我们的html客户端

from pyquery import PyQuery as Pq # pyquery来操作dom

class SegmentfaultQuestionSpider(object):

def __init__(self, segmentfault_id): # 参数为在segmentfault上的id

self.url = 'http://segmentfault.com/q/{0}'.format(segmentfault_id)

self._dom = None # 弄个这个来缓存获取到的html内容,一个蜘蛛应该之访问一次

@property

def dom(self): # 获取html内容

if not self._dom:

document = requests.get(self.url)

document.encoding = 'utf-8'

self._dom = Pq(document.text)

return self._dom

@property

def title(self): # 让方法可以通过s.title的方式访问 可以少打对括号

return self.dom('h1#questionTitle').text() # 关于选择器可以参考css selector或者jquery selector, 它们在pyquery下几乎都可以使用

@property

def content(self):

return self.dom('.question.fmt').html() # 直接获取html 胆子就是大 以后再来过滤

@property

def answers(self):

return list(answer.html() for answer in self.dom('.answer.fmt').items()) # 记住,Pq实例的items方法是很有用的

@property

def tags(self):

return self.dom('ul.taglist--inline > li').text().split() # 获取tags,这里直接用text方法,再切分就行了。一般只要是文字内容,而且文字内容自己没有空格,逗号等,都可以这样弄,省事。

3、然后,再把玩一下升级后的蜘蛛。

>>> from sfspider import spider

>>> s = spider.SegmentfaultQuestionSpider('1010000002542775')

>>> print s.title

>>> 微信JS—SDK嵌套选择图片和上传图片接口,实现一键上传图片,遇到问题

>>> print s.content

>>> # [故意省略] #

>>> for answer in s.answers print answer

>>> # [故意省略] #

>>> print '/'.join(s.tags)

>>> 微信js-sdk/python/微信开发/javascript

1、下面,我要写一个抓取标签页面的问题的爬虫。代码如下, 注意下面的代码是添加在已有代码下面的, 和之前的最后一行之间 要有两个空行

class SegmentfaultTagSpider(object):

def __init__(self, tag_name, page=1):

self.url = 'http://segmentfault.com/t/%s?type=newest&page=%s' % (tag_name, page)

self.tag_name = tag_name

self.page = page

self._dom = None

@property

def dom(self):

if not self._dom:

document = requests.get(self.url)

document.encoding = 'utf-8'

self._dom = Pq(document.text)

self._dom.make_links_absolute(base_url="http://segmentfault.com/") # 相对链接变成绝对链接 爽

return self._dom

@property

def questions(self):

return [question.attr('href') for question in self.dom('h2.title > a').items()]

@property

def has_next_page(self): # 看看还有没有下一页,这个有必要

return bool(self.dom('ul.pagination > li.next')) # 看看有木有下一页

def next_page(self): # 把这个蜘蛛杀了, 产生一个新的蜘蛛 抓取下一页。 由于这个本来就是个动词,所以就不加@property了

if self.has_next_page:

self.__init__(tag_name=self.tag_name ,page=self.page+1)

else:

return None

2、现在可以两个蜘蛛一起把玩了,就不贴出详细把玩过程了。。。

>>> from sfspider import spider

>>> s = spider.SegmentfaultTagSpider('微信')

>>> question1 = s.questions[0]

>>> question_spider = spider.SegmentfaultQuestionSpider(question1.split('/')[-1])

>>> # [故意省略] #

想做小偷站的,看到这里基本上就能搞出来了。 套个模板 加一个简单的脚本来接受和返回请求就行了。